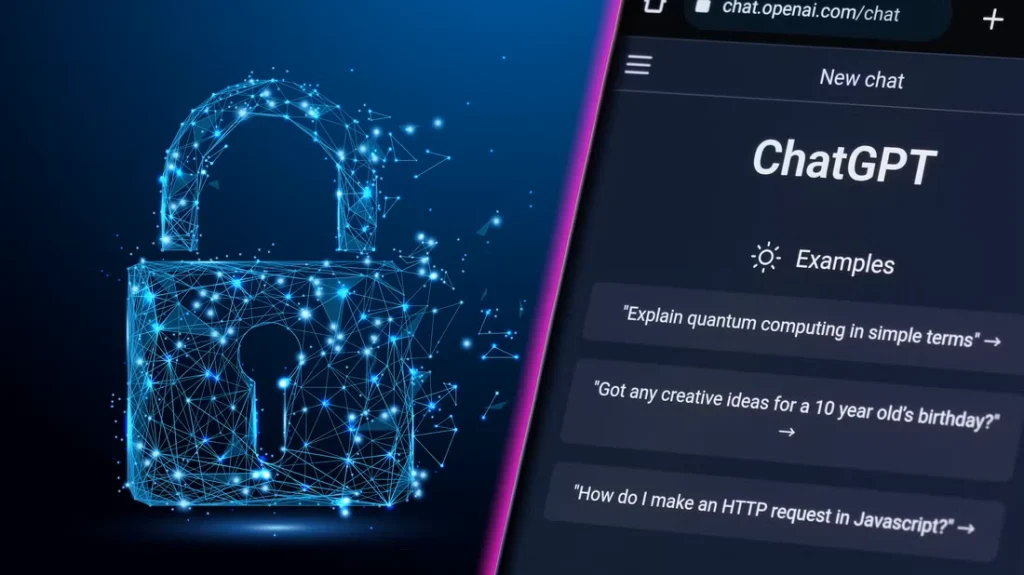

چت رباتهای هوش مصنوعی مولد شگفتانگیز هستند، اما نمیتوانیم وانمود کنیم که آنها بیعیب هستند. همانطور که استفاده ما از هوش مصنوعی افزایش می یابد، درک این نکته بسیار مهم است که برخی از اطلاعات بهتر است خصوصی نگه داشته شوند و هرگز با یک ربات چت هوش مصنوعی به اشتراک گذاشته نشوند.

خطرات حریم خصوصی چت ربات های هوش مصنوعی

چت ربات های هوش مصنوعی مانند ChatGPT و Gemini گوگل محبوب هستند زیرا می توانند پاسخ هایی شبیه به انسان ایجاد کنند. با این حال، اتکای آنها به مدلهای زبان بزرگ (LLM) با خطرات حریم خصوصی و امنیتی همراه است. این آسیبپذیریها نشان میدهد که چگونه اطلاعات شخصی به اشتراکگذاشتهشده در طول تعاملات ممکن است افشا شود یا مورد سوء استفاده قرار گیرد.

- شیوه های جمع آوری داده ها: چت ربات های هوش مصنوعی از داده های آموزشی گسترده ای استفاده می کنند که ممکن است شامل تعاملات کاربر باشد. شرکتهایی مانند OpenAI به کاربران اجازه میدهند از جمعآوری دادهها انصراف دهند، اما اطمینان از حفظ حریم خصوصی میتواند چالشبرانگیز باشد.

- آسیب پذیری های سرور: داده های ذخیره شده کاربر مستعد تلاش های هک هستند، به طوری که مجرمان سایبری به طور بالقوه این اطلاعات را سرقت کرده و برای اهداف مخرب سوء استفاده می کنند.

- دسترسی شخص ثالث: داده های حاصل از تعاملات چت بات را می توان با ارائه دهندگان خدمات شخص ثالث به اشتراک گذاشت یا توسط پرسنل مجاز به آنها دسترسی پیدا کرد و خطر نقض را افزایش می دهد.

- عدم استفاده از تبلیغات (ادعا شده): در حالی که شرکتها ادعا میکنند که دادهها را برای بازاریابی نمیفروشند، اما برای نگهداری سیستم و اهداف عملیاتی به اشتراک گذاشته میشود.

- نگرانی های مولد هوش مصنوعی: منتقدان استدلال می کنند که پذیرش فزاینده هوش مصنوعی مولد می تواند این خطرات امنیتی و حریم خصوصی را تشدید کند.

اگر میخواهید هنگام استفاده از ChatGPT و سایر رباتهای چت هوش مصنوعی از دادههای خود محافظت کنید، ارزش آن را دارد که خطرات حفظ حریم خصوصی را درک کنید. در حالی که شرکتهایی مانند OpenAI شفافیت و کنترل را ارائه میکنند، پیچیدگیهای اشتراکگذاری دادهها و آسیبپذیریهای امنیتی نیاز به هوشیاری دارند.

برای اطمینان از حریم خصوصی و امنیت خود، پنج نوع داده کلیدی وجود دارد که هرگز نباید با یک چت ربات هوش مصنوعی مولد به اشتراک بگذارید.

1. جزئیات مالی

با استفاده گسترده از چت ربات های هوش مصنوعی، بسیاری از کاربران برای مشاوره مالی و مدیریت امور مالی شخصی به این مدل های زبانی روی آورده اند. در حالی که آنها می توانند سواد مالی را افزایش دهند، دانستن خطرات احتمالی اشتراک گذاری جزئیات مالی با چت ربات های هوش مصنوعی بسیار مهم است.

هنگامی که از چت بات ها به عنوان مشاور مالی استفاده می کنید، در معرض خطر قرار دادن اطلاعات مالی خود در معرض مجرمان سایبری بالقوه هستید که می توانند از آن برای تخلیه حساب های شما سوء استفاده کنند. علیرغم ادعای شرکتها مبنی بر ناشناس کردن دادههای مکالمه، اشخاص ثالث و برخی از کارمندان ممکن است همچنان به آن دسترسی داشته باشند. به عنوان مثال، یک ربات چت ممکن است عادت های خرج کردن شما را برای ارائه مشاوره تجزیه و تحلیل کند، اما اگر نهادهای غیرمجاز به این داده ها دسترسی داشته باشند، می توانند برای پروفایل شما برای کلاهبرداری، مانند ایمیل های فیشینگ تقلید از بانک شما، استفاده شوند.

برای محافظت از اطلاعات مالی خود، تعاملات خود را با چت رباتهای هوش مصنوعی به اطلاعات کلی و سوالات گسترده محدود کنید. به اشتراک گذاری جزئیات حساب خاص، تاریخچه تراکنش ها یا رمزهای عبور می تواند شما را آسیب پذیر کند. اگر به مشاوره مالی شخصی نیاز دارید، یک مشاور مالی دارای مجوز، گزینه ایمن تر و مطمئن تر است.

2. افکار شخصی و صمیمی

بسیاری از کاربران برای جستجوی درمان به چت رباتهای هوش مصنوعی روی میآورند و از عواقب بالقوه آن برای سلامت روانی خود آگاه نیستند. درک خطرات افشای اطلاعات شخصی و صمیمی برای این رباتهای گفتگو ضروری است.

چت رباتهای هوش مصنوعی فاقد دانش دنیای واقعی هستند و فقط میتوانند پاسخهای عمومی را به پرسشهای مربوط به سلامت روان ارائه دهند. این بدان معناست که داروها یا درمان هایی که آنها پیشنهاد می کنند ممکن است برای نیازهای خاص شما مناسب نباشد و به سلامت شما آسیب برساند.

علاوه بر این، به اشتراک گذاری افکار شخصی با چت ربات های هوش مصنوعی، نگرانی های قابل توجهی را در مورد حفظ حریم خصوصی ایجاد می کند. ممکن است حریم خصوصی شما به عنوان اسرار شما به خطر بیفتد و افکار صمیمی ممکن است به صورت آنلاین به بیرون درز کند یا به عنوان بخشی از داده های آموزشی هوش مصنوعی استفاده شود. افراد مخرب می توانند از این اطلاعات برای جاسوسی از شما یا فروش داده های شما در وب تاریک سوء استفاده کنند. بنابراین، حفظ حریم خصوصی افکار شخصی هنگام تعامل با رباتهای چت هوش مصنوعی مهم است.

چت ربات های هوش مصنوعی به جای جایگزینی برای درمان حرفه ای، ابزارهایی برای اطلاعات عمومی و پشتیبانی هستند. اگر به مشاوره یا درمان سلامت روان نیاز دارید، با یک متخصص بهداشت روان واجد شرایط مشورت کنید. آنها می توانند راهنمایی شخصی و قابل اعتماد ارائه دهند و در عین حال حریم خصوصی و رفاه شما را در اولویت قرار دهند.

3. اطلاعات محرمانه محل کار

اشتباه دیگری که کاربران هنگام تعامل با چت ربات های هوش مصنوعی باید از آن اجتناب کنند، اشتراک گذاری اطلاعات محرمانه مربوط به کار است. غولهای فناوری برجسته مانند اپل، سامسونگ و گوگل کارمندان خود را از استفاده از چت رباتهای هوش مصنوعی در محل کار محدود کردهاند.

گزارش بلومبرگ موردی را نشان میدهد که در آن کارمندان سامسونگ از ChatGPT برای اهداف برنامهنویسی استفاده کرده و بهطور ناخواسته کدهای حساس را روی پلتفرم هوش مصنوعی بارگذاری کردهاند. این حادثه منجر به افشای غیرمجاز اطلاعات محرمانه در مورد سامسونگ شد و این شرکت را وادار کرد تا استفاده از ربات چت هوش مصنوعی را ممنوع کند. اگر از هوش مصنوعی برای حل مشکلات کدنویسی (یا هر مشکل دیگری در محل کار) استفاده می کنید، نباید به چت ربات های هوش مصنوعی با اطلاعات محرمانه اعتماد کنید.

به همین ترتیب، بسیاری از کارمندان برای خلاصه کردن دقایق جلسات یا خودکارسازی کارهای تکراری به چت رباتهای هوش مصنوعی متکی هستند که خطر افشای ناخواسته دادههای حساس را به همراه دارد. شما می توانید با توجه به خطرات مرتبط با به اشتراک گذاری داده های مربوط به کار، از اطلاعات حساس محافظت کنید و از سازمان خود در برابر نشت ناخواسته یا نقض داده ها محافظت کنید.

4. رمزهای عبور

اشتراک گذاری رمزهای عبور خود به صورت آنلاین، حتی با مدل های زبان بزرگ، ممنوع است. این مدلها دادهها را روی سرورها ذخیره میکنند و افشای رمزهای عبور شما برای آنها حریم خصوصی شما را به خطر میاندازد.

یک نقض قابل توجه داده مربوط به ChatGPT در ماه مه 2022 رخ داد و نگرانی هایی را در مورد امنیت پلتفرم های چت بات ایجاد کرد. علاوه بر این، ChatGPT در ایتالیا به دلیل مقررات عمومی حفاظت از داده های اتحادیه اروپا (GDPR) ممنوع شد. رگولاتورهای ایتالیایی ربات چت هوش مصنوعی را با قوانین حفظ حریم خصوصی منطبق نمیدانند و خطرات نقض دادهها در این پلتفرم را برجسته میکنند. مدتهاست که این ممنوعیت لغو شده است، اما نشان میدهد که اگرچه شرکتها اقدامات امنیتی دادهها را افزایش دادهاند، آسیبپذیریها همچنان وجود دارد.

برای محافظت از اعتبار ورود خود، هرگز آنها را با چت بات ها به اشتراک نگذارید، حتی برای اهداف عیب یابی. اگر نیاز به بازنشانی یا مدیریت رمزهای عبور دارید، از مدیران رمزهای اختصاصی یا پروتکلهای امن IT سازمان خود استفاده کنید.

5. جزئیات مسکونی و سایر داده های شخصی

درست مانند رسانه های اجتماعی و دیگر پلتفرم های آنلاین، نباید هیچ گونه اطلاعات شناسایی شخصی (PII) را با یک ربات چت هوش مصنوعی به اشتراک بگذارید. PII شامل داده های حساسی مانند موقعیت مکانی، شماره تامین اجتماعی، تاریخ تولد و اطلاعات سلامتی است که می تواند برای شناسایی یا مکان یابی شما استفاده شود. به عنوان مثال، ذکر غیرمستقیم آدرس منزل خود در حین درخواست از یک ربات چت برای خدمات نزدیک می تواند به طور ناخواسته شما را در معرض خطر قرار دهد. اگر این داده ها رهگیری یا فاش شود، شخصی می تواند از آن برای سرقت هویت یا یافتن شما در دنیای واقعی استفاده کند. به طور مشابه، اشتراک گذاری بیش از حد در پلتفرم های ادغام شده با هوش مصنوعی، مانند اسنپ چت، می تواند ناخواسته بیشتر از آنچه در نظر گرفته شده است، درباره شما فاش کند.

برای حفظ حریم خصوصی دادههای خود هنگام درگیر شدن با رباتهای چت هوش مصنوعی، در اینجا چند روش کلیدی وجود دارد که باید دنبال کنید:

- با سیاست های حفظ حریم خصوصی چت بات ها آشنا شوید تا خطرات مرتبط با آن را درک کنید.

- از پرسیدن سوالاتی که ممکن است ناخواسته هویت یا اطلاعات شخصی شما را فاش کند، خودداری کنید.

- احتیاط کنید و از به اشتراک گذاری اطلاعات پزشکی خود با ربات های هوش مصنوعی خودداری کنید.

- هنگام استفاده از چت ربات های هوش مصنوعی در پلتفرم های اجتماعی مانند اسنپ چت مراقب آسیب پذیری های احتمالی داده های خود باشید.

چت ربات های هوش مصنوعی برای بسیاری از کاربردها فوق العاده هستند، اما خطرات جدی حفظ حریم خصوصی را نیز به همراه دارند. محافظت از دادههای شخصی شما هنگام استفاده از ChatGPT، Copilot، Claude یا هر ربات چت هوش مصنوعی دیگر نیز دشوار نیست. فقط یک لحظه به این فکر کنید که اگر اطلاعاتی که به اشتراک می گذارید فاش شود چه اتفاقی می افتد. سپس، خواهید دانست که در مورد چه چیزی صحبت کنید و چه چیزی را برای خود نگه دارید.

مطلب مرتبط:۴ روش هوش مصنوعی برای بهتر کردن تلویزیون های هوشمند